Entwicklung, Produktion und Programmierung eines auf dem Ambisonics-Algorithmus basierenden 3D-Sounddesign für ein Theaterstück

Ein Kreativprojekt im Rahmen des Free Multimedia Electives von Anne M. Himmelmann

4. Semester, 2017

Betreuender Dozent: Thorsten Greiner

Sound, Music and Production

Im Rahmen des Free Multimedia Electives wurde ein Sounddesign für ein Theaterstück des Hessischen Landestheater Marburgs entwickelt. Der persönliche Anspruch dabei war, für den Zuschauer ein ganz besonderes Theatererlebnis zu erschaffen, in dem der Sound nicht wie sonst üblich in Stereo produziert und abgespielt wird, sondern von allen Seiten um den Zuschauer herum hörbar ist. Er befindet sich so mitten im Zentrum des Geschehens und die Sounds erreichen ihn nicht nur von vorne, sondern aus allen Richtungen.

Das Projekt war neben der technischen auch eine künstlerische Herausforderung, da man als Sounddesigner großen Einfluss auf die Dramaturgie des Stückes hat und eng mit Regisseuren und Dramaturgen zusammen arbeiten muss. Im Folgenden soll allerdings überwiegend auf die technischen Aspekte sowie die Erfahrungen in dem Projektes eingegangen werden.

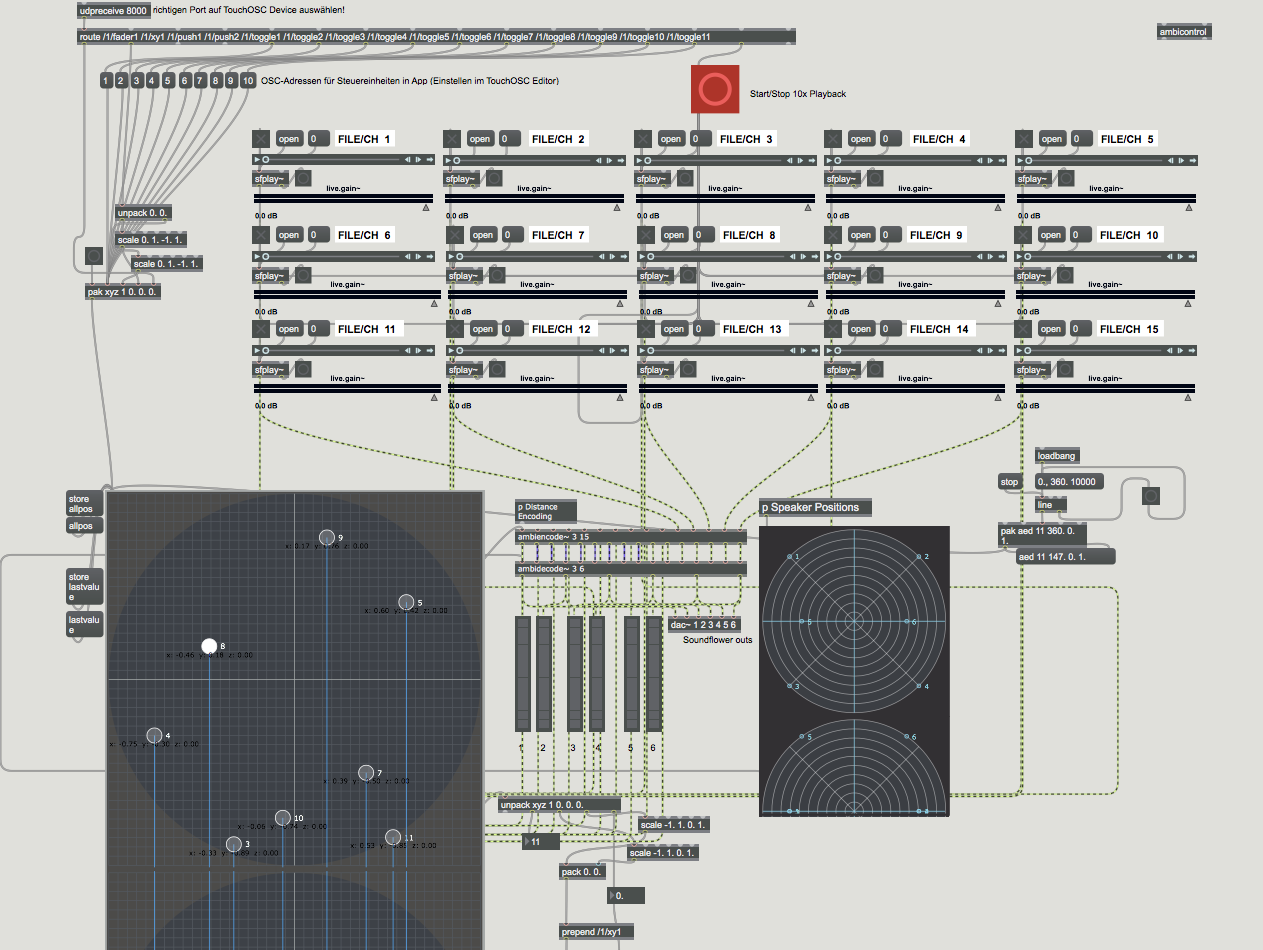

Es gibt verschiedene Ansätze für die Produktion und Wiedergabe von 3D-Sound, es wurde allerdings bewusst der Ambisonics-Algorithmus, implementiert in einer vom ICST entwickelten Library für MAX/MSP, ausgewählt.

Ambisonics ist ein Verfahren zur Aufnahme und Wiedergabe eines Klangfeldes. Diese Audiotechnologie wurde in den 1960er und 1970er Jahren in Großbritannien entwickelt und im Wesentlichen von Michael A. Gerzon und Peter Fellgett vorangetrieben. Im Unterschied zu den kanalorientierten Übertragungsverfahren ist für die Wiedergabe keine feste Anzahl von Lautsprechern vorgegeben. Die jeweiligen Signale werden nach mathematischen Vorgaben aus den übertragenen Werten für Schalldruck- und Schallschnelle für jede einzelne Lautsprecherposition berechnet. (Quelle: Wikipedia)

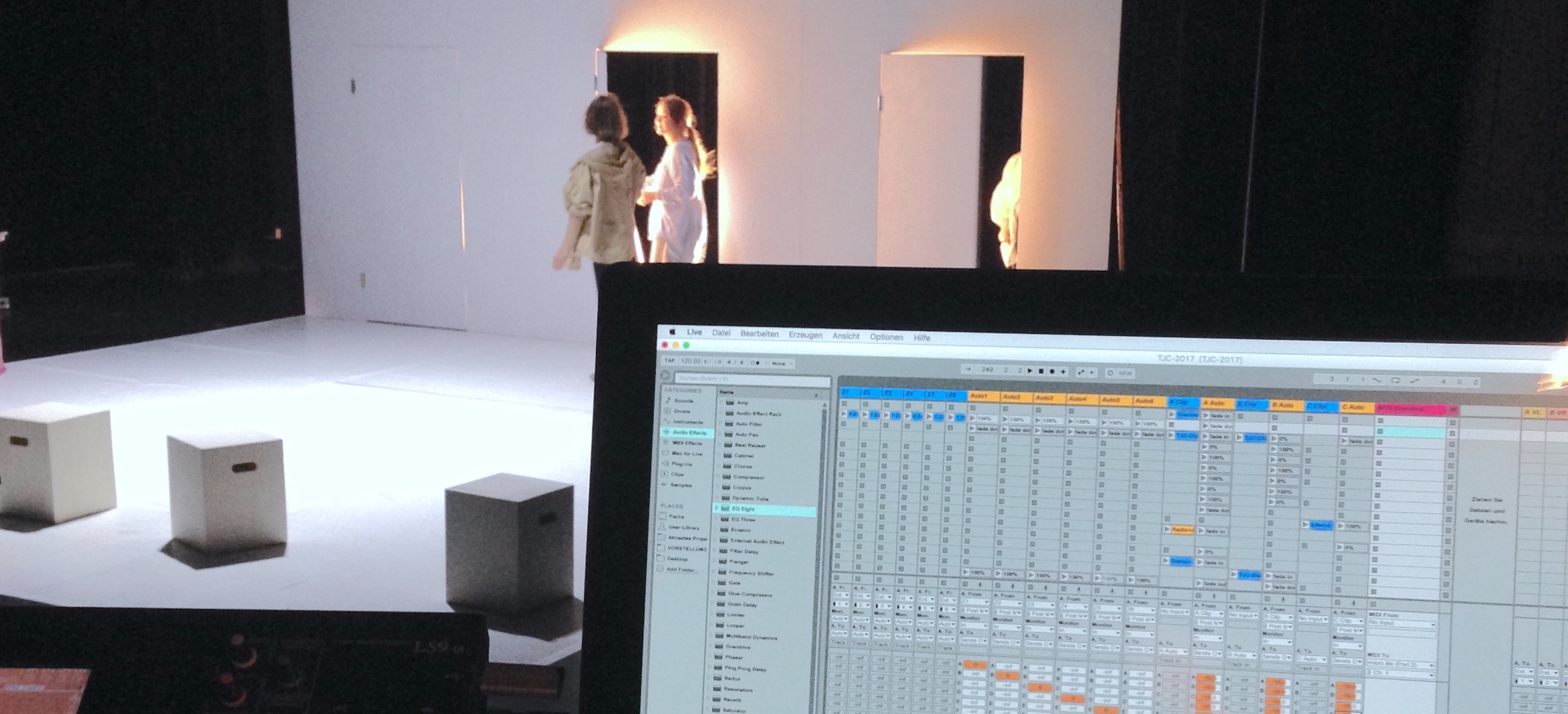

Mit diesen Tools für MAX/MSP ist man also flexibel in der Anzahl und Anordnung der Lautsprecher und kann die Sound-Programmierung mit wenigen Modifizierungen an verschiedene Setups anpassen. Auf der Studiobühne im Theater wurden 6 Lautsprecher + Bass genutzt, wobei der Bass nicht in der Programmierung implementiert war, sondern einfach die Summe der Ausspielwege als Signal bekam.

4 Lautsprecher waren auf einer Ebene etwa einen halben Meter über den Zuschauern im Quadrat um das Publikum angeordnet, zwei weitere hingen in einer Höhe von etwa 6 Metern in der Mitte des Hör-Quadrates.

Zum Vorgehen:

Nach vielen Gesprächen und Probenbesuchen wurden im ersten Schritt alle benötigten Sounds als normale Stereotracks zur Rücksprache mit Regie und Dramaturgie sowie zur Nutzung der Schauspieler bei den Proben produziert.

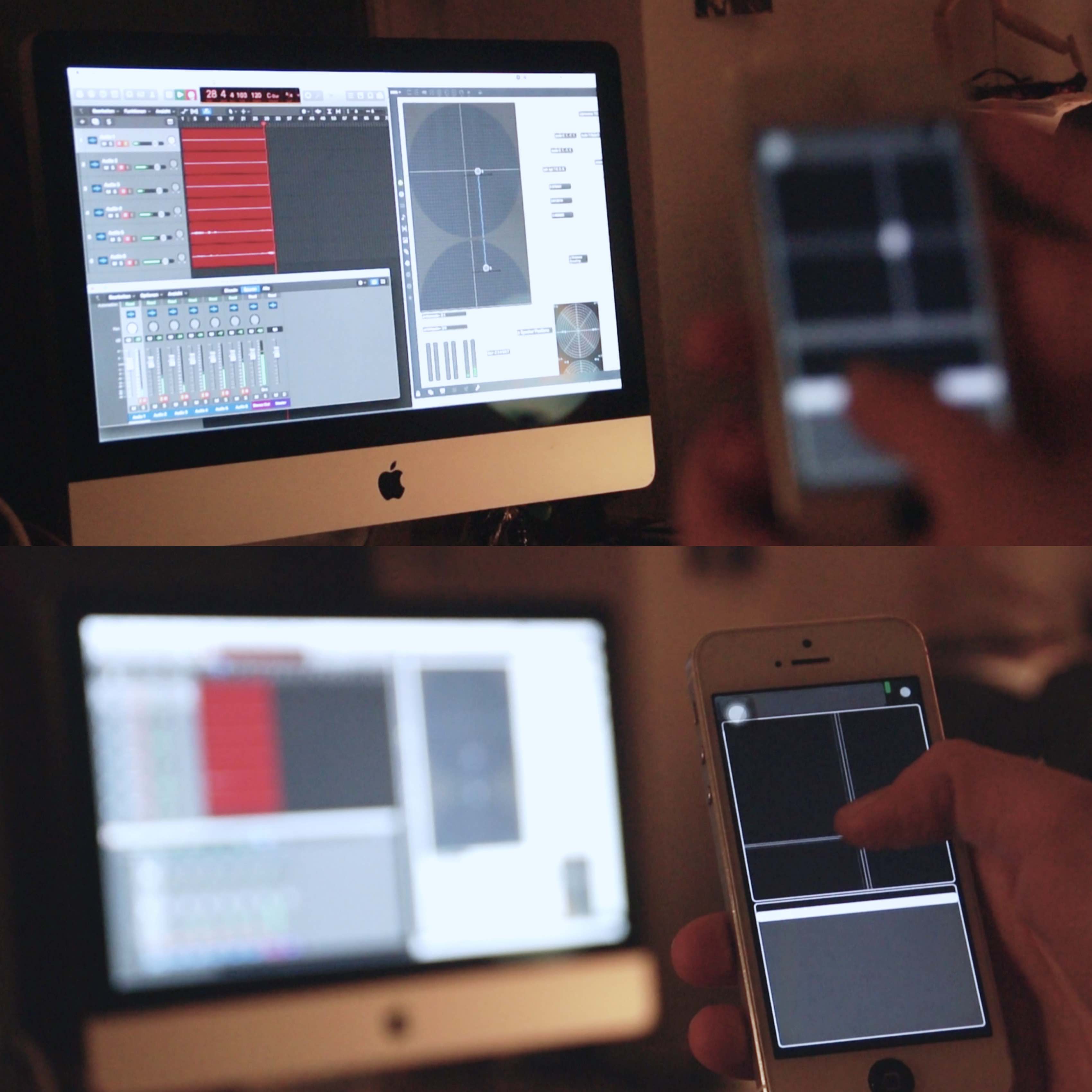

Im nächsten Schritt wurden die Einzelspuren der jeweiligen Einspielungen in einen MAX/MSP-Patch, der den einzelnen Spuren virtuelle Soundquellen zuordnet, geladen. Diese können über die X-, Y- und Z- Achse verschoben werden und somit frei im Raum bewegt werden.

Zur besseren Lokalisation der virtuellen Schallquellen (der FoH-Platz im Theater befindet sich leider am äußeren Rand des Hör-Quadrates) wurde über das UDP/OSC-Protokoll eine schlichte App fürs Smartphone gebaut, mit der verschiedene Schallquellen angewählt und platziert werden können – sozusagen eine Art Fernsteuerung für den MAX/MSP-Patch sowie die DAW.

Manchmal ist es sinnvoll, Spuren eine feste Position im Raum zu geben und die Einspielung „starr“ als große 3D-Klangfläche abzuspielen; es gibt aber auch Szenen, in denen eine Bewegung einer oder mehrerer Schallquellen eine besondere dramaturgische Wirkung hat. Wirkungsvoll war zum Beispiel die Bewegung von Melodiephrasen von Stimme und Cello in den vielen Traumszenen um den Zuschauer herum zu bewegen, um das Gefühl von Absurdität, Wahnsinn und Surrealität zu erzeugen. Bei naturalistischeren Darstellungen von Szenen (Streitgespräche, romantische Szenen) standen die Soundquellen überwiegend fest im Raum.

Um diese Bewegungen nicht bei jedem Durchlauf des Stückes live über Smartphone oder PC mitfahren zu müssen und Bewegungsautomationen der virtuellen Schallquellen in MAX für die große Anzahl an Quellen extrem viel Rechenpower braucht (für den Live-Betrieb problematisch), wurden die Bewegungen und Platzierungen der einzelnen Spuren vorher über eine interne virtuelle Soundkarte für die 6 Ausspielwege aufgenommen.

Der Ambisonics-Encoder beziehungsweise -Decoder berechnete also für die festgesetzte Anzahl an Lautsprechern und Schallquellen im Vorfeld jeweils die einzelnen Lautstärkeverhältnisse der Quellen in Abhängigkeit derer Position für die Ausspielwege.

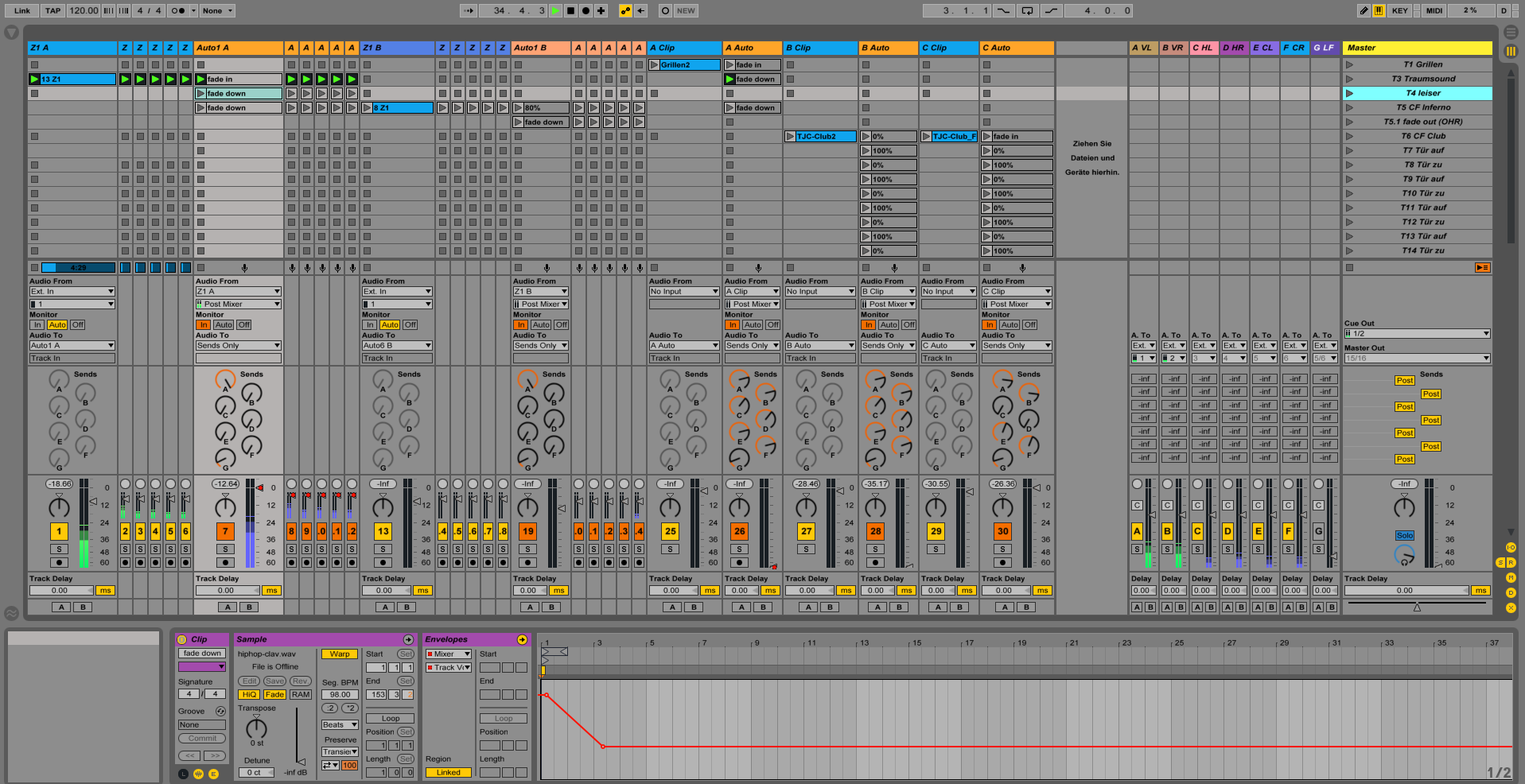

Das Fahren der Shows selbst lief über eine Szenenprogrammierung in Ableton.

Die Session wurde so gebaut, dass auch ein Tontechniker, der das Stück nicht kennt, mit Hilfe der Inspzienz die Show anhand von Toncues fahren kann, in die bereits Lautstärkeautomationen, Crossfades, Filterfahrten und so weiter einprogrammiert sind.

Fazit

Ich habe durch das Projekt die Grenzen eines quadrophonischen Lautsprechersetups erfahren und viel über Ambisonics und seine Anwendung – gerade für Theater – gelernt. An meinem MAX/MSP-Patch werde ich noch weiter arbeiten und ihn optimieren; für eine erste Erprobung kann ich mit dem Ergebnis zufrieden sein – von den Zuschauern der Theatervorstellungen habe ich durchweg positive Rückmeldungen für mein 3D-Sounddesign erhalten.

Fotos der Schauspieler: ©Joscha Mengel